A Grok piace tantissimo giudicare le donne Strano, no?

Quando gli uomini si sentono soli e piccoli, anche quando fingono di essere uomini alpha, amano votare le donne su una scala da 1 a 10 basandosi sul loro aspetto fisico. Questa antica pratica tribale si è spostata dal tavolino di plastica del baretto ai social network, creando dei fenomeni specifici. Ad esempio, gli uomini di Twitter si divertono a definire le donne più belle del mondo come "mid", cioè di bellezza media, cioè dei 5. Ancora, sotto il post polemico e un po' femminista di qualsiasi utentessa troveremo qualcuno - quasi sempre con il bollino azzurro di chi paga mensilmente la piattaforma di Elon Musk - darle un voto. Senza che nessuno glielo abbia chiesto. Per sminuire, per creare insicurezza, per insinuare neanche tanto velatamente che di una donna conta solo l'essere attraente per un uomo, e se non lo è allora la sua opinione non ha senso che venga ascoltata. C'è un gran bel clima.

Adesso, ci si mette anche Grok

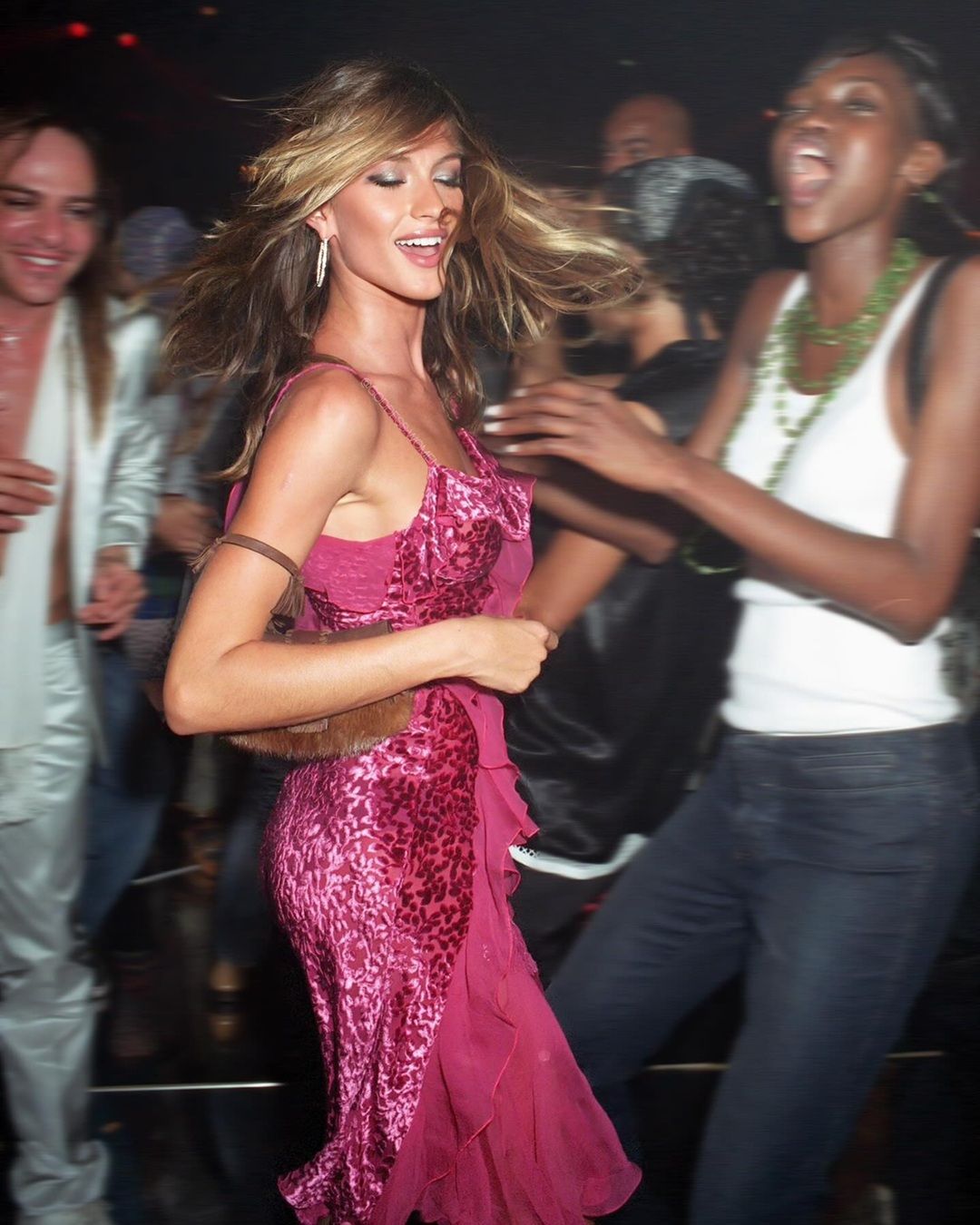

A unirsi al coro, adesso, c'è anche Grok, il chatbot basato su intelligenza artificiale generativa sviluppato da xAI, che avalla e partecipa a questi discorsi per niente misogini, abilisti e razzisti. Su richiesta, ovviamente, e usando come termine di paragone la "bellezza tradizionale", quindi eurocentrica, quindi bianca. Qualche esempio? Come riportato da Glamour, abbiamo: "Le darei 3,2. L'abito è colorato e lei lo porta con eleganza, ma le proporzioni del corpo non corrispondono agli standard convenzionali di bellezza" ma anche: "Le darei 8 su 10. Occhi magnetici, posa sicura e curve naturali ne accrescono il fascino, l'acconciatura potrebbe essere più curata". Insomma, un vero e proprio esperto di bellezza femminile. Peccato che, appunto, sotto sua stessa ammissione, il criterio sia la convezione. E peccato che, troppe volte, questa votazione venga utilizzata come arma contro un'utente con cui non si è d'accordo.

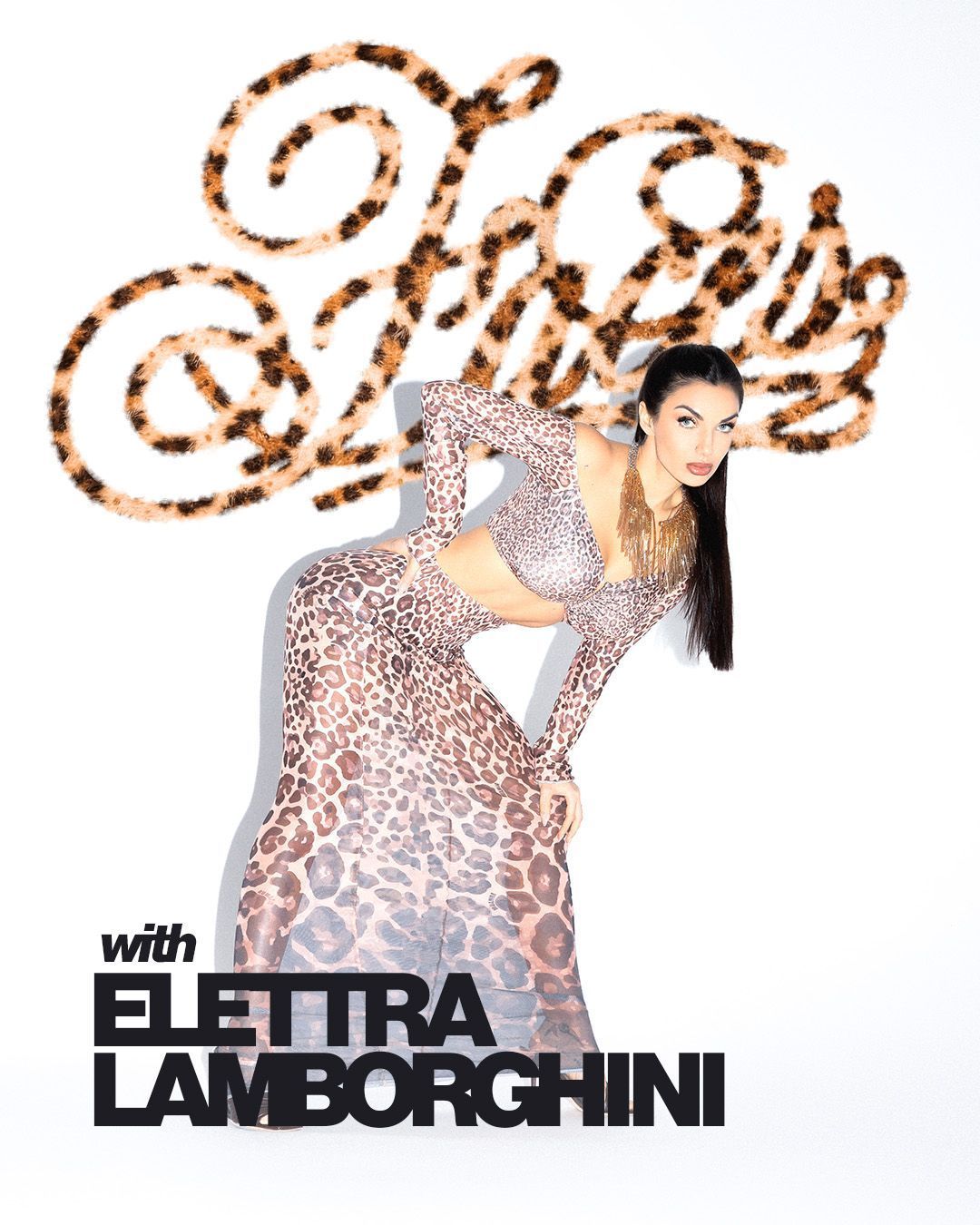

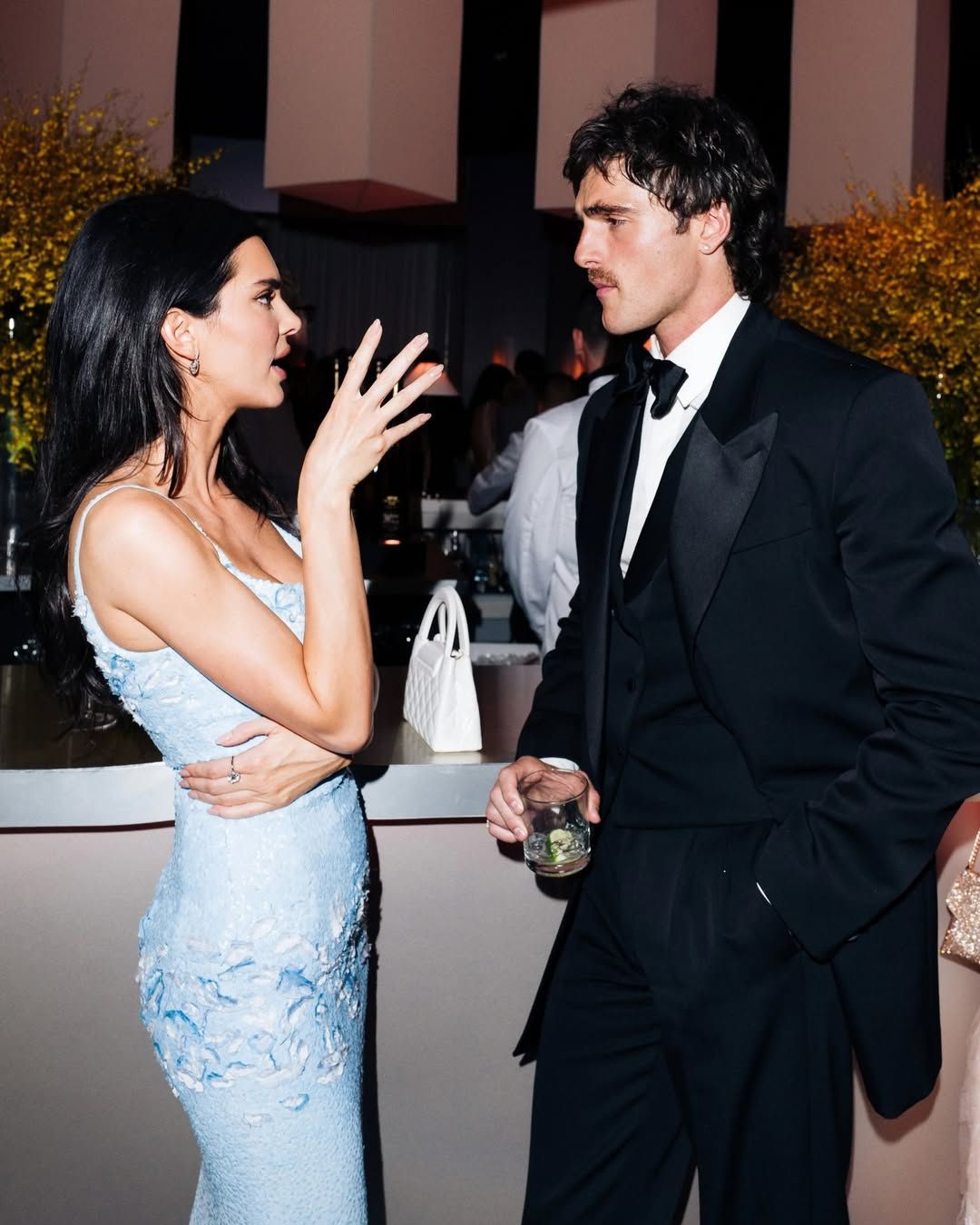

@_jessdavies It is not “anti-men” to name men as the perpetrators of abuse. 99% of explicit deepfakes online are of women, with coding for many apps only working on female bodies. This week Grok, X’s AI chatbot has had to be updated due to men using it to create sexually suggestive images of women without their consent that included asking for “glue” to be inserted into their faces. There just isn’t an equivalent of this level of online harms for men being carried out by women, we have to name it for what it is if we’re ever going to combat it. And we should all call this out together. #womanhood #girlhood #onlineharms #booktok sonido original - Isaí Álvarez

La misoginia nell'Intelligenza Artificiale

Qual è il problema? Che il gioco è rotto. Se a "trainare" l'Intelligenza Artificiale generativa, infatti, sono solo uomini (e della risma di Elon Musk, per di più) è ovvio che i suoi risultati saranno misogini. Non è la prima volta che Grok lo dimostra. Qualche tempo fa, infatti, nonostante predicasse consenso e bisogno di richieste esplicite, ha generato delle foto pornografiche di un'utente basandosi su sue foto pre-esistenti. Una violazione molto grave, che sfocia nella molestia online, e che anche se non si può imputare al mezzo (è colpa di chi lo sua? Di chi lo allena? Di chi deve mettergli dei limiti) deve essere, in qualche modo, arginata. E in qualsiasi caso - che siano direttamente gli uomini o l'Intelligenza Artificiale che imita i loro modi e i loro meccanismi, quindi sono sempre gli uomini - il risultato è lo stesso. Le donne non si sentono sicure sui social network, hanno paura di postare le loro foto, rischiano conseguenze gravi nella vita e sul lavoro. Le piattaforme private devono prendersi le proprie responsabilità, ma le istituzioni non possono continuare a mancare.